.avif)

Table des matières

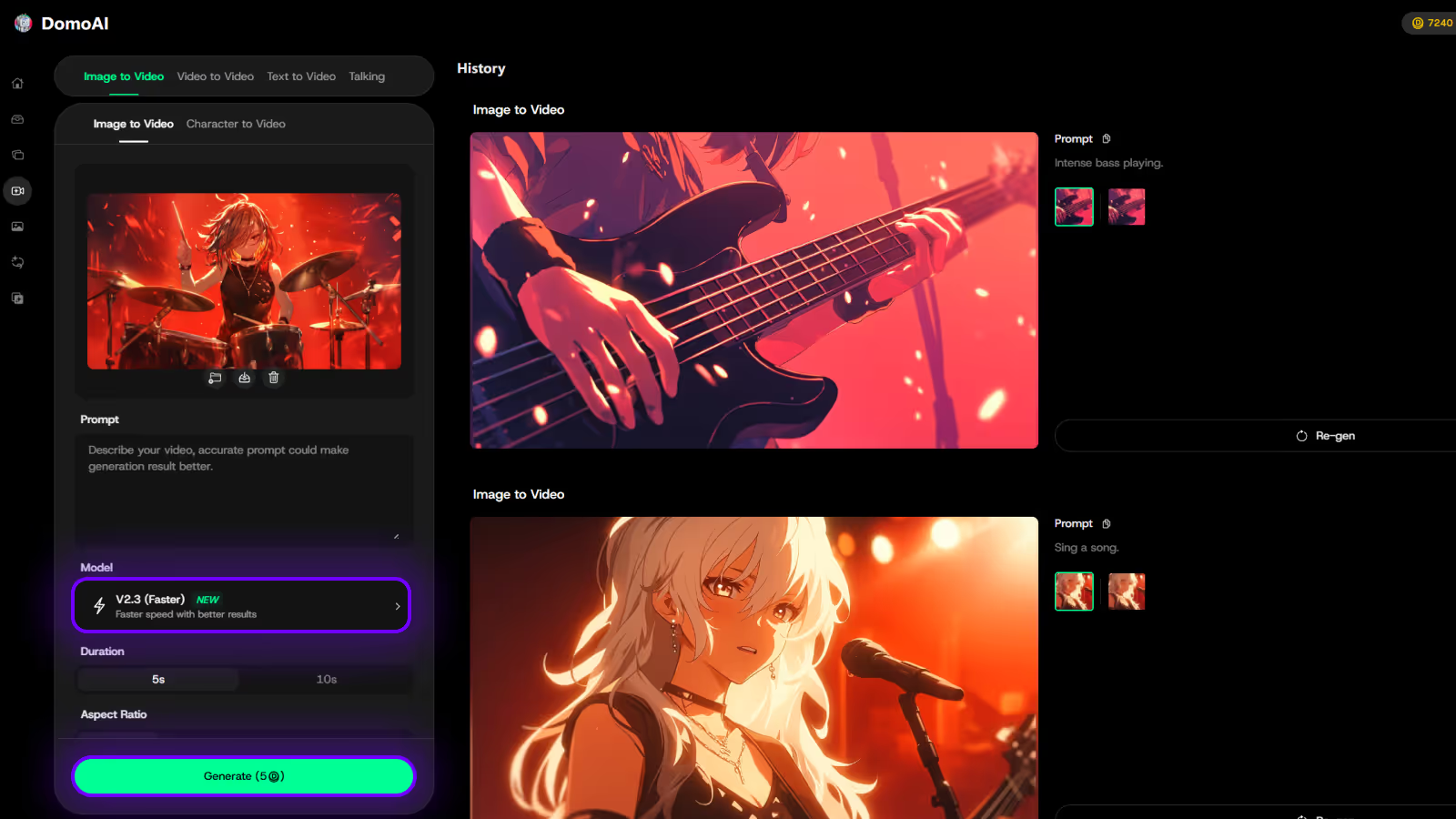

Essayez DomoAI, le meilleur générateur d'animation IA

Transformez n'importe quel texte, image ou vidéo en vidéos animées, réalistes ou artistiques. Plus de 30 styles uniques disponibles.

Si vous photographiez avec Vélo 3 caméra, vous êtes confronté à des heures de séquences qui doivent être découpées, synchronisées et peaufinées avant d'atteindre les joueurs ou les clients. LTX Studio propose un montage vidéo basé sur l'IA, une transcription automatique et des modèles de mouvement, mais de nombreux créateurs sont toujours aux prises avec des rendus lents, des délais maladroits ou une faible collaboration. Vous recherchez un moyen plus simple de comparer les options et de trouver des outils qui vous permettent de gagner du temps et de respecter votre flux de travail ? Cet article vous présente les meilleures alternatives à LTX Studio pour les vidéos et le montage d'IA, en mettant en évidence des fonctionnalités telles que la découpe automatique, les sous-titres automatiques, la détection de scènes, la collaboration dans le cloud, l'étalonnage des couleurs et les formats d'exportation afin que vous puissiez choisir la solution qui vous convient.

Pour vous aider à tester de réelles alternatives, DomoAi's Générateur vidéo AI propose des découpes automatisées, des sous-titres pleins d'humour, des animations basées sur des modèles et une collaboration basée sur le cloud afin que vous puissiez passer plus rapidement d'une séquence brute à une vidéo soignée.

L'un des outils les plus pertinents pour les créateurs qui cherchent à rationaliser leur flux de travail de post-production est le Upscaler vidéo AI. Lorsque vous travaillez avec des images provenant de caméras telles que le Veo 3, la résolution et la clarté peuvent faire ou défaire le produit final, en particulier si les clips sont réutilisés pour des vidéos de temps forts, des présentations ou des réseaux sociaux.

De nombreux utilisateurs souhaitent que la manière dont LTX Studio transforme les scènes et les images clés en un script généré par l'IA soit transparente. Voir l'invite compilée complète aide les créateurs à prévoir la production, ajustez les jetons de style et évitez les surprises, comme le rendu d'une scène « animée » dans le style anime au lieu du HDR.

L'exportation ou l'affichage de ce texte accélère également le débogage, permet d'obtenir des résultats reproductibles et permet aux équipes de contrôler la version des modifications apportées aux instructions narratives. Préférez-vous modifier le texte plutôt que de reproduire des plans entiers pour tester un seul mot ?

Direction de la voix et mouvement de la bouche renforcer la crédibilité du travail sur les personnages. Les créateurs demandent une synchronisation au niveau du phonème, un contrôle plus précis de l'intonation et une superposition plus facile de plusieurs pistes vocales dans une seule scène.

Ils souhaitent également un clonage vocal intégré, une meilleure gestion de la langue et des repères visuels indiquant où les lignes audio atteindront une image-clé. Lorsque les lèvres et le son ne sont pas synchronisés, cet écart devient la première chose que le public remarque.

De nombreux éditeurs ont besoin d'une option de maintien de la prise de vue valide pour qu'une seule image puisse être jouée plus longtemps sans ajouter d'images-clés factices ni figer des couches. Une fonction de mise en attente native réduirait l'encombrement de la chronologie et garderait intactes les courbes de mouvement de la caméra.

Cela permet de gagner du temps lors du découpage et de corriger les interpolations étranges au cours d'une pause. À quelle fréquence restructures-tu une scène juste pour allonger un temps ?

Les rendus de haute qualité dans LTX Studio peuvent nécessiter beaucoup de calculs pour les projets longs. Les créateurs recherchent des aperçus locaux plus rapides, un rendu par proxy ou une exportation GPU par lots pour accélérer les itérations.

Un modèle de rendu mixte cloud et local ou une file d'attente de rendu avec des paramètres de priorité raccourciraient les boucles de feedback et réduiraient les coûts du cloud. Des aperçus plus rapides permettent de prendre des décisions créatives se produisent en quelques minutes, pas en quelques heures.

Certaines équipes ont besoin d'un fonctionnement hors ligne pour des raisons de confidentialité ou pour utiliser des parcs de GPU sur site. Le rendu local réduit également la dépendance à la vitesse d'Internet et aux crédits cloud.

Une option permettant d'exécuter les flux de travail LTX Studio sur site, avec mise en cache et exportation des ressources locales, convient aux personnes suivantes :

Avez-vous besoin de tout pour rester derrière votre pare-feu ?

Un catalogue d'actifs intégré plus important et davantage de clips gratuits accéléreraient la production pour les créateurs qui ne peuvent pas acheter des vidéos onéreuses. L'amélioration du balisage des actifs, du contrôle des versions et des métadonnées de licence au sein du projet améliorerait la réutilisation des œuvres épisodiques.

Les modèles intégrés et les préréglages de scène fournis avec des ressources libres de droits réduiraient le temps de préparation.

LTX Studio allie facilité d'utilisation et outils avancés, mais les commandes de l'appareil photo, le cadrage de touches avancé et certaines fonctionnalités vocales nécessitent encore un apprentissage. Les créateurs demandent des didacticiels étape par étape, d'autres astuces intégrées à l'application et des exemples de projets illustrant des configurations complexes du début à la fin.

Une documentation plus précise réduit les frictions pour les équipes qui tentent de faire évoluer les flux de travail.

Les équipes s'attendent à des exportations flexibles pour la post-production :

L'accès aux API, les SDK et l'intégration avec Premiere ou Final Cut accélèrent le transfert aux monteurs et aux concepteurs sonores. Les niveaux de tarification et le partage collaboratif de projets déterminent également quel outil convient au pipeline d'un studio.

Les utilisateurs font l'éloge de LTX Studio pour son storyboard, sa forte persistance des personnages, son interface utilisateur intuitive et ses sorties cinématiques. Ce respect alimente la curiosité pour d'autres outils susceptibles d'ajouter une fonctionnalité manquante ou d'accélérer une partie du flux de travail.

Quelle lacune spécifique est la plus importante pour vos projets, et souhaitez-vous des recommandations pour des alternatives qui répondent à ces besoins ?

Demandez si la plateforme couvre :

Bénéficiez d'une collaboration à distance facilitée, d'une sortie à faible latence et d'une prise en charge efficace des remplacements de touches chromatiques ou de sets virtuels. Avez-vous besoin d'un découpage automatique pour les clips sociaux ou d'une réaffectation rapide d'événements enregistrés ?

Choisissez des plateformes dotées de fonctionnalités robustes pilotées par l'IA, telles que la génération de texte-vidéo, la transcription automatique des surlignages et la création de scènes assistée par l'IA. Ces outils devraient prendre en charge le cadrage automatique de la caméra, la détection des haut-parleurs et le montage intelligent qui transforme les séquences brutes en segments soignés sans longues passes manuelles.

Vous voulez tester la rapidité avec laquelle vous pouvez transformer un événement enregistré en courtes vidéos pour les réseaux sociaux ou en séquences vidéo ?

Recherchez de nombreuses bibliothèques de modèles, des packs d'animations graphiques et des commandes de style personnalisées afin de conserver des visuels cohérents d'un épisode à l'autre et chaînes.

L'édition flexible de la chronologie, le contrôle des images clés et les préréglages au niveau de la scène vous permettent d'ajuster le rythme, les couleurs et les mouvements en fonction de la voix de la marque. Pouvez-vous importer facilement vos polices, vos palettes de couleurs et vos designs tiers inférieurs ?

Recherchez des outils offrant des options de rendu multi-angles, des animations de personnages réalistes et une génération de scènes dynamiques qui permettent de créer de nouveaux mouvements de caméra ou des compositions alternatives à partir de la même source.

Des modèles génératifs efficaces fourniront des avatars parlants synchronisés avec les lèvres, des looks stylisés comme ceux des anime ou des films, et des arrière-plans procéduraux qui remplaceront les œuvres sur fond vert. Quelle partie de votre temps après le travail peut représenter transmis aux processus génératifs sans perdre le contrôle de la création ?

Priorisez les plateformes qui prennent en charge le traitement par lots, les ajustements de scène automatisés et les pipelines de rendu rapides. Recherchez le rendu dans le cloud, les exportations planifiées et les intégrations avec les outils de publication sociale afin de pouvoir publier à grande échelle.

L'outil vous permet-il de passer de l'ébauche à la version finale en quelques étapes automatisées tout en préservant les flux de travail multi-utilisateurs ?

Choisissez une solution qui exporte de manière cohérente en 1080p et 4K, préserve les fréquences d'images et maintient une compression propre pour les scènes riches en mouvements. Vérifiez le rendu accéléré par le matériel, la gestion des couleurs et les commandes de débit afin que les visuels restent nets et que les mouvements restent naturels pendant le streaming et le téléchargement.

Est-ce que votre lecture des fichiers finaux proprement sur :

La création de vidéos sympas impliquait auparavant des heures de montage et beaucoup de savoir-faire technique, mais DomoAi Éditeur vidéo AI change complètement cela : vous pouvez transformer des photos en clips animés, donner à des vidéos un aspect d'anime ou créer des avatars parlants simplement en tapant ce que vous voulez.

Il est conçu pour que tout le monde puisse créer du contenu attrayant sans avoir à apprendre des outils complexes. Vous pouvez donc vous concentrer sur l'idée et laisser l'IA gérer le travail technique. Créez votre première vidéo gratuitement avec Accueil AI aujourd'hui !

Accueil AI transforme les images fixes en clips animés et crée des avatars parlants à partir de scripts saisis. Il privilégie la facilité d'utilisation par rapport au storyboard granulaire, ce qui permet aux créateurs de passer de l'idée au clip final sans avoir à se soucier des commandes de la chronologie ou de la composition complexe des scènes.

Vous pouvez changer de style visuel à l'aide des options suivantes :

It pairs well with LTX Studio when you want fast social posts or experimental shots rather than cinematic scene control. The platform offers a free first video so you can test its creative workflow before subscribing.

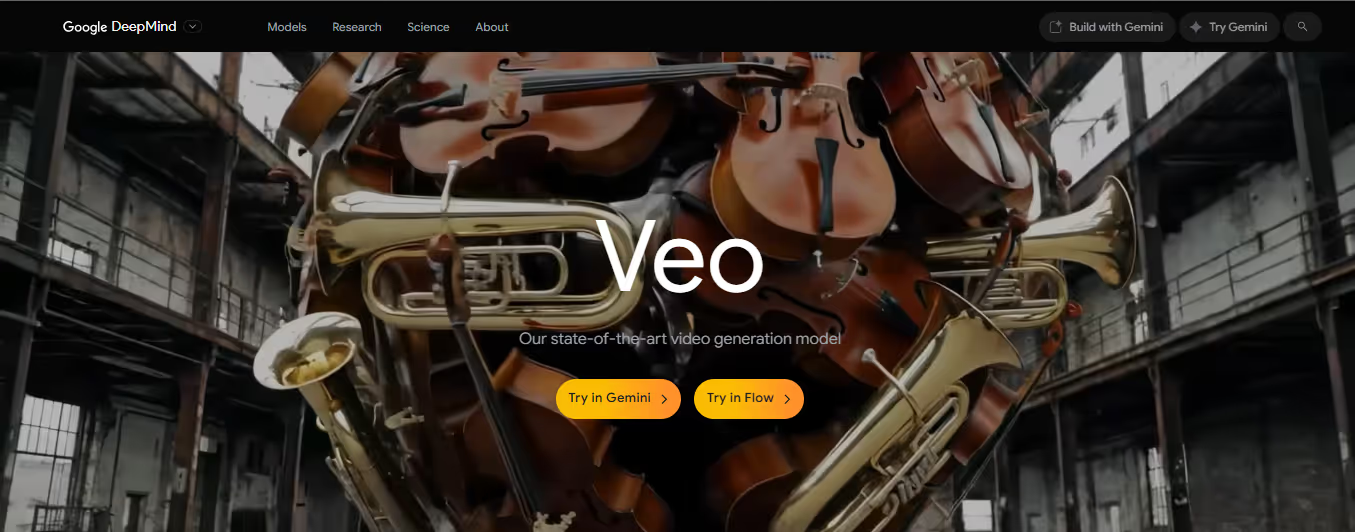

Veo 3 generates natural-looking scenes and layers matching background sound from simple text prompts. It renders smooth motion, believable lighting, and environmental audio like crowd noise or traffic, which helps with continuity and immersion.

Templates and voiceover support make it approachable for content teams and single creators. Watch for:

Use it when you need prompt-driven, realistic scenes with quick template-based assembly.

Kling AI produces short, polished videos with cinematic lighting and camera work, such as pans and zooms. The output quality leans toward professional grade, with smooth motion and detailed render quality.

Limitations include short maximum clip length and missing lip sync in some cases. Pricing reflects the high quality and may be a factor if you need large volumes. Choose Kling when you want short ads, promos, or high-fidelity snippets without deep editing.

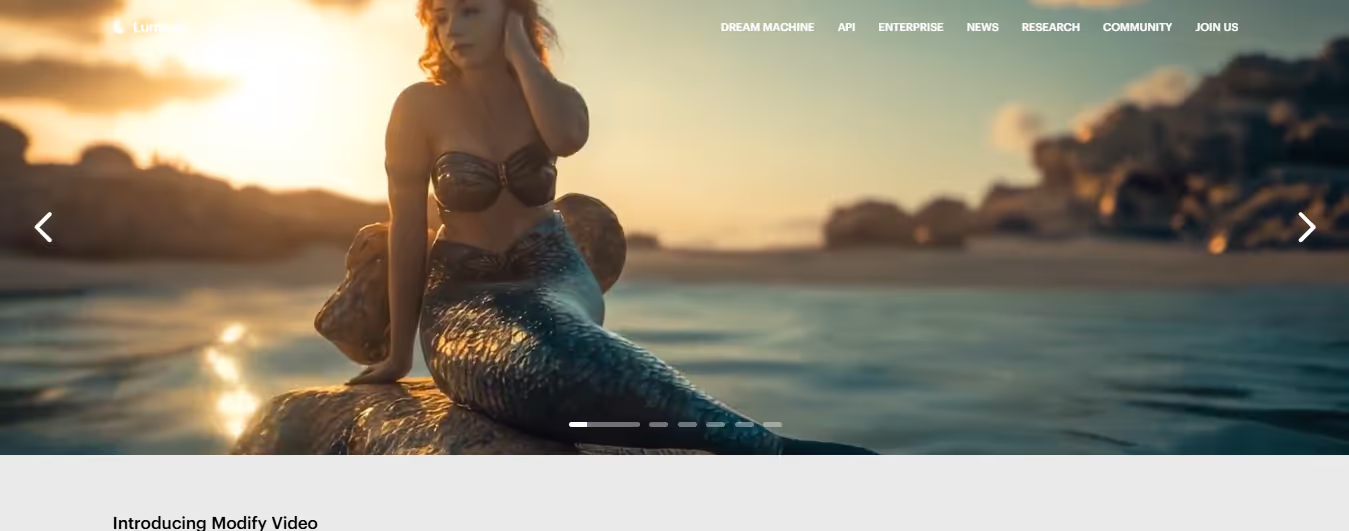

Luma AI focuses on speed and photoreal motion. It can produce many frames very quickly and uses motion that respects physical behavior for natural tracking shots and 360-degree moves. The platform supports multi-scene sequences so you can stitch longer narratives with consistent camera planning.

Some built-in editing tools are lighter than what editors expect, which makes it well-suited to teams that export to a conventional NLE for finishing. Use Luma when realistic motion and rapid rendering matter.

Pika animates uploads into short HD clips and specializes in novel visual effects: items sliced, crushed, or inflated, and other creative transformations.

It caps outputs around ten seconds, which fits:

The tool emphasizes effect-driven creativity rather than scene continuity or multi-shot storyboarding. Try Pika for punchy, single-idea pieces where visual novelty matters.

Hailuo AI converts text or images into 6 to 10-second cinematic clips with smooth camera moves like tracking shots. Characters hold consistent facial features and outfits across scenes, improving continuity and character persistence for short narratives.

Resolution support reaches 1080p. Some complex motion can still appear slightly glitchy, so keep heavy action modest. Ideal use cases include teaser clips and product showcases that need crisp framing.

Haiper AI interprets text prompts accurately and often produces lively, colorful videos with realistic motion and physics. It animates stills well and supports varied motion styles.

The UI keeps the process simple and accessible, which helps teams turn a script into a clip rapidly. If you need predictability and a balanced feature set between effects and realism, Haiper is a dependable choice.

Vidu AI responds quickly to detailed direction and handles artistic and cinematic looks with equal skill. You can convert sketches or images into animated sequences and preserve drawn characters across shots.

The editor gives fine control over:

This tool fits creators who want to guide style closely while avoiding deep manual editing.

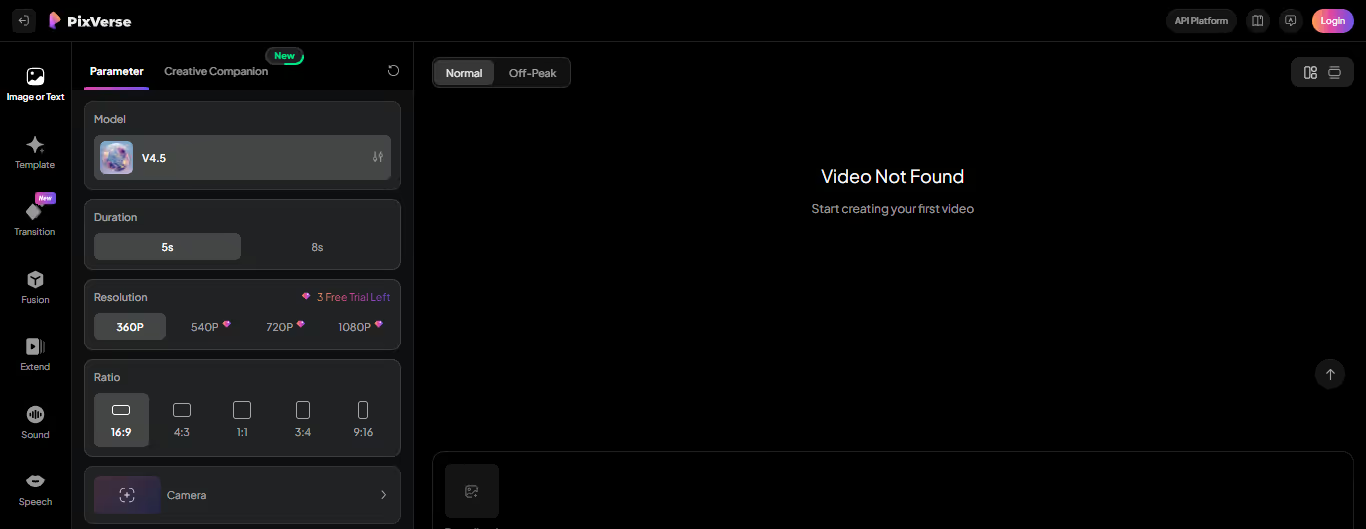

PixVerse AI offers many technical settings for fine-tuning render style, duration, aspect ratio, and special effects. It demands a learning curve but rewards users with granular control over the scene:

Camera controls feel limited compared with some competitors, so plan shots with that constraint in mind. Use PixVerse when you want to push creative control and already understand prompt-to-video workflows.

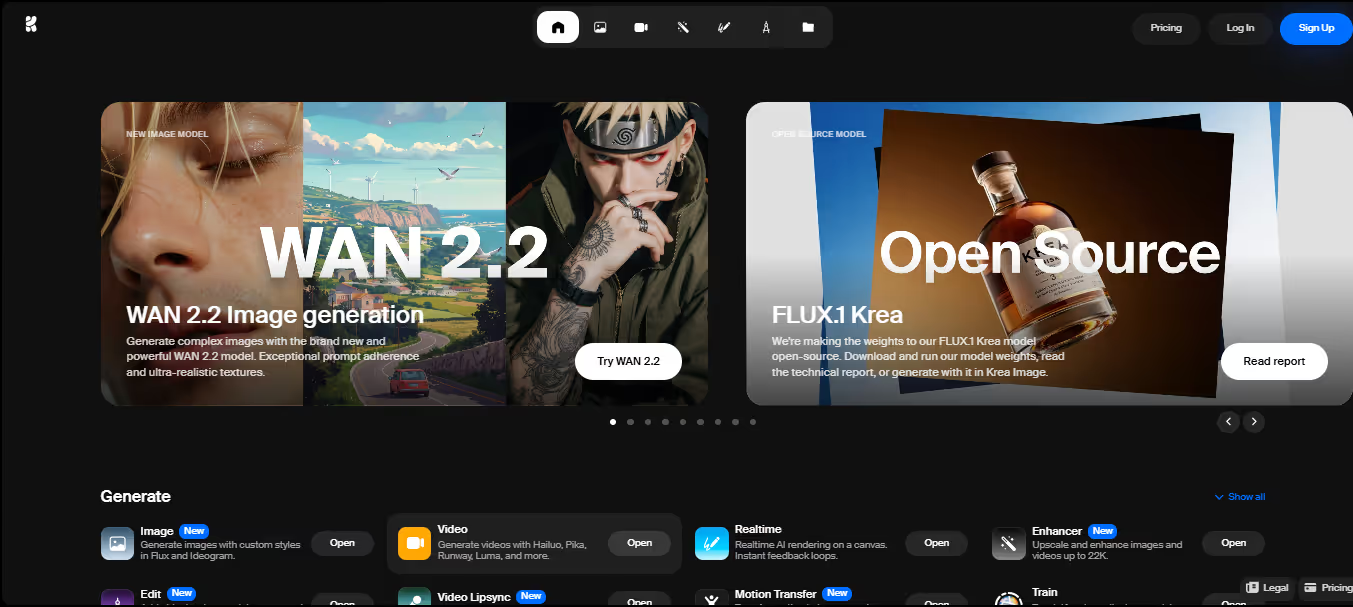

KREA strips the interface down to essentials so newcomers can generate clips quickly. It provides model switching to try different visual styles and has quality enhancement tools to boost output fidelity.

A free plan exists with usage limits, making KREA a reasonably low-risk starting point. Expect a straightforward script to video flow rather than an advanced scene timeline or persistent character systems.

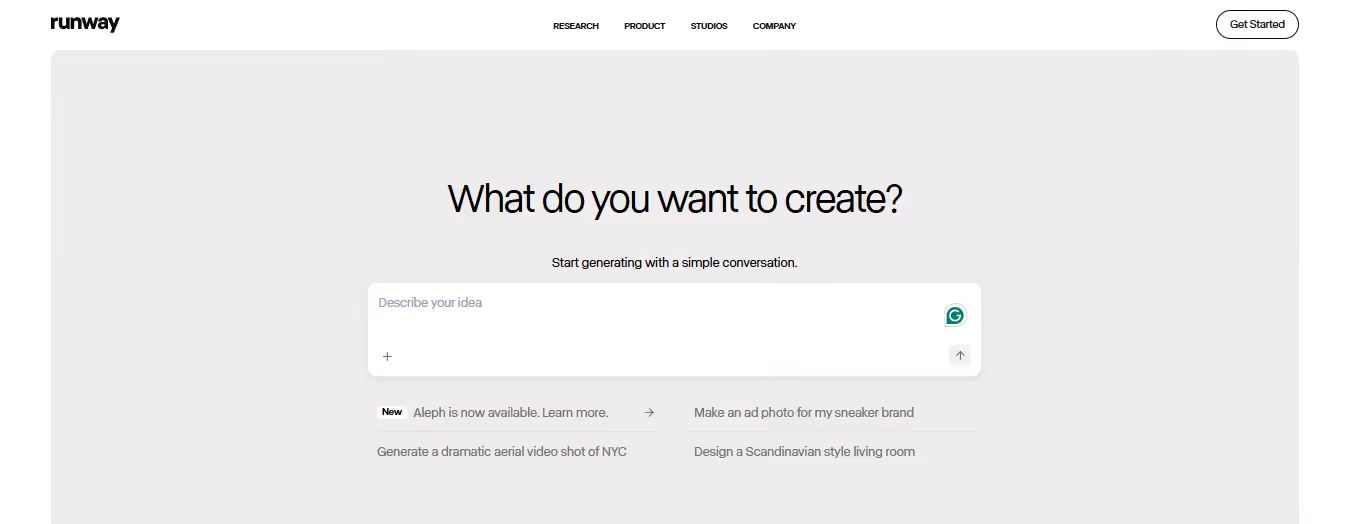

Runway pairs text to video generation with a nonlinear timeline, versioned clips, and frame-level editing. It supports inpainting, scene continuity tools, and model options for different looks.

Teams use Runway when they need a hybrid workflow that mixes AI generation with conventional editing:

It scales well for collaborative projects that require both creative control and AI-assisted speed.

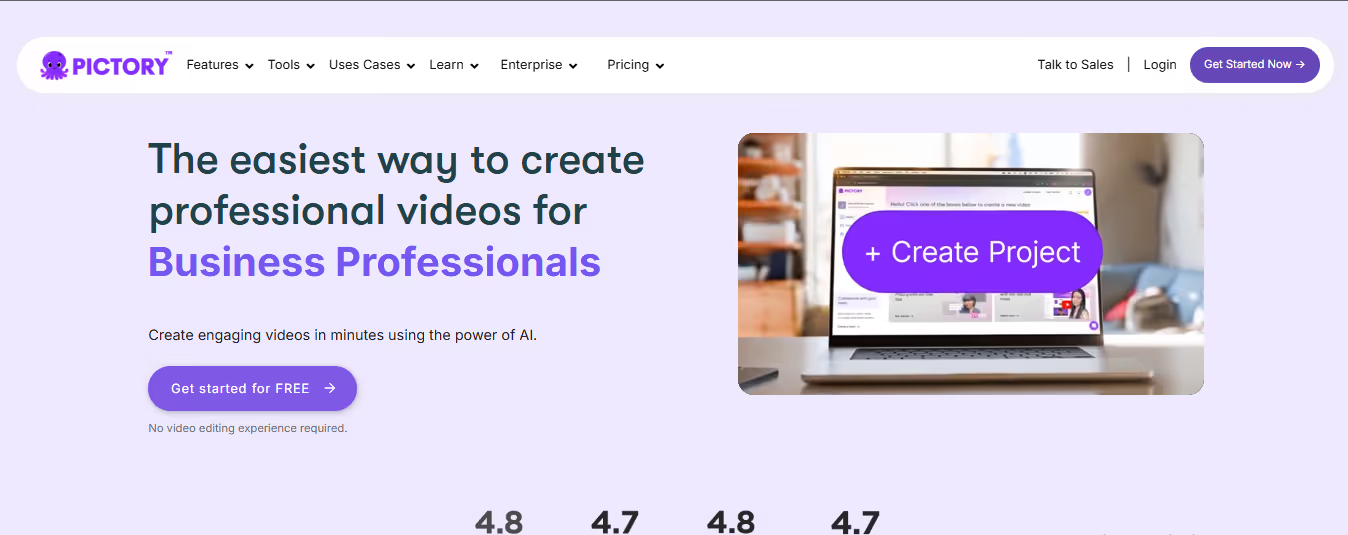

Pictory builds videos from scripts using stock footage, music, and voiceovers through template-driven workflows. It focuses on content production for:

It has simple editing steps and clear tutorials.

Users can add:

Pictory suits creators who prefer template-led assembly over frame-by-frame scene control and need quick turnarounds.

Elai generates video with digital avatars speaking scripted text and supports more than 75 languages. You can select from a diverse avatar library or request a custom avatar from submitted footage.

The workflow is efficient for localized corporate messages, training, or marketing where on-camera talent is costly. Elai reduces shoot complexity and helps scale personalized video production.

Hour One converts text into videos using selectable characters and themes, producing polished product and training content in minutes. It targets business users who need repeatable, scalable outputs without full production teams.

The UI focuses on speed:

This tool works well for enterprises that need consistent messaging across many clips.

Colossyan aims at workplace learning by letting creators build training videos using avatars, captions, and an editor designed for clarity. The platform makes it easier to produce studio-style material without a film crew.

Users report strong support and steady feature updates, while some symbol handling and edge cases can be improved. Pick Colossyan when you need efficient, consistent educational content with rapid turnaround.

.avif)

Generative Adversarial Networks and diffusion models generate realistic visuals and entire scenes from text prompts, while transformer-based NLP handles:

These systems let an AI video platform convert a written brief into timing, camera moves, and assets automatically.

LTX Studio ties these engines together with real-time rendering, synthetic media avatars, and automated editing pipelines so teams can move from script to screen without a whole film crew.

Traditional production required weeks of planning, casting, location shoots, and long post-production cycles. The AI-enhanced workflow replaces many manual steps:

This shift has a créé une efficacité remarquable des gains, les entreprises signalant des réductions allant jusqu'à 80 % des délais et des coûts de production grâce à une automatisation vidéo avancée. Ces gains d'efficacité permettent aux marques de produire davantage de contenu qui stimule les ventes.

LTX Studio et les plateformes de production vidéo cloud similaires regroupent la préproduction et le montage dans la même session, ce qui réduit les transferts et les transferts de stockage et permet une itération continue.

Les outils vidéo basés sur l'IA mettent l'accent sur trois résultats commerciaux directement liés aux revenus :

Ces fonctionnalités s'intègrent aux plateformes publicitaires, aux analyses et aux systèmes de gestion des actifs afin que les équipes créatives puissent traiter la vidéo comme un canal marketing piloté par les données.

LTX Studio propose des API pour la publication et le balisage automatisés, ce qui rend les résultats créatifs exploitables pour les équipes de croissance.

L'IA permet de créer de nombreuses versions adaptées à la culture à partir d'un seul concept. Remplacez les arrière-plans, échangez les voix off, changez les couleurs de votre garde-robe et échangez le texte à l'écran en fonction de la langue et des repères culturels.

Une marque de cosmétiques peut produire des spots français avec des champs de lavande et des spots asiatiques avec des visuels tropicaux à partir d'un seul brief.

LTX Studio propose des avatars localisés, un doublage automatique et des files d'attente de rendu en masse afin que les équipes puissent proposer des centaines de variantes régionales tout en suivant l'engagement par marché.

Au lieu de deviner quel titre ou quel CTA sera converti, générez des dizaines de permutations créatives et proposez-les à de petites cohortes.

Liens de collecte de métriques automatisés chaque variante créative pour :

LTX Studio prend en charge les tests multiversions, le balisage des variantes et l'exportation vers des plateformes d'analyse afin que les spécialistes du marketing puissent identifier les éléments gagnants en quelques heures et allouer les dépenses aux plus performants.

Lorsqu'une tendance se dessine, c'est la rapidité qui compte. L'IA élimine les blocages liés au rendu et à la logistique afin que les équipes puissent ajouter des lignes spécifiques aux tendances, changer de musique ou échanger des actifs et se relancer rapidement. Une marque de boissons a utilisé un fichier principal pour créer 32 modifications locales et les mettre en ligne en quelques jours.

Vous voulez faire une promotion de dernière minute ? Utilisez la conversion de texte en vidéo, la voix off automatique et la génération de scènes LTX Studio pour produire un nouveau montage et le redéployer sur toutes les chaînes en moins d'une heure.

Quelle partie de votre pipeline de production automatiseriez-vous en premier et quels indicateurs de performance clés suivriez-vous pour prouver l'impact ?

Accueil AI supprime la courbe d'apprentissage abrupte et les longues heures de montage manuel. Vous chargez des images ou des séquences, tapez ce que vous voulez et l'IA génère :

L'interface ressemble à un simple panneau de configuration de studio et vous guide à travers les choix suivants :

Qui veut se débattre avec des délais alors que vous pouvez plutôt travailler à partir d'idées ?

Déposez une photo dans DomoAI et la plateforme analyse la profondeur, les traits du visage et l'arrière-plan pour ajouter du mouvement et de la parallaxe. L'outil crée des mouvements de caméra naturels, une respiration subtile et des changements d'éclairage réalistes pour qu'une seule image devienne cinématographique.

Vous souhaitez utiliser ce vieux portrait pour un court clip social ou une carte promotionnelle pour une configuration de diffusion avec des sets virtuels de style LTX Studio ? La sortie correspond aux formats de diffusion standard.

Tapez quelques mots et DomoAI applique le transfert de style pour convertir les images en images inspirées de l'anime. Vous pouvez choisir des palettes de couleurs, des fréquences d'images et l'intensité de l'ombrage des cellules pour obtenir des illustrations douces ou des looks de bandes dessinées plus nets.

Utilisez-le pour des courts métrages de marque, des diffusions de contenu ou des séquences expérimentales qui se marient bien avec les superpositions en temps réel et les arrière-plans virtuels utilisés dans les studios professionnels.

Créez un avatar parlant à partir d'une photo ou d'un modèle 3D et rédigez le script. DomoAi synchronise les mouvements des lèvres, les expressions faciales et les tournages de tête avec le son généré ou avec la piste vocale que vous avez téléchargée. Vous pouvez acheminer l'avatar vers une diffusion en direct ou exporter des clips pour les réseaux sociaux.

Vous voulez créer un animateur à la caméra sans toute une équipe de production en studio ? C'est ce que fait cet outil et prend en charge les flux de travail d'avatar courants utilisés dans les configurations de production cloud et de production virtuelle.

DomoAI convient aux créateurs solo qui ont besoin de contenu rapide et aux équipes qui souhaitent des ressources cohérentes sur tous les canaux. Il prend en charge plusieurs formats d'image pour Instagram Reels, TikTok, les courts métrages YouTube et diffuse des exportations sécurisées pour les flux de studio multicaméra.

Si vous exécutez la production à distance ou que vous utilisez LTX Studio pour des événements en direct, vous pouvez créer des ressources dans DomoAI et les intégrer à votre scène avec les mêmes spécifications de couleur et de synchronisation.

L'éditeur automatise la sélection des prises de vue, le chronométrage et l'étalonnage des couleurs afin que vous n'ayez pas à régler manuellement tous les paramètres. Il interprète votre message, applique un suivi de mouvement stable et adapte la dynamique audio aux coupures.

Vous pouvez annuler n'importe quel choix à l'aide de commandes manuelles, mais la plupart des utilisateurs terminent un brouillon vierge en quelques minutes tout en respectant les normes de diffusion pour la diffusion en direct et la post-production basée sur le cloud.

Accueil AI exporte des codecs et des fréquences d'images standard qui s'insèrent directement dans les outils de production en direct et les ensembles virtuels. Utilisez les clips comme tiers inférieurs, bobines de pare-chocs ou arrière-plans animés dans un flux de travail LTX Studio.

La plateforme prend également en charge les rendus rapides pour les présentateurs à distance, les superpositions interactives et les ressources graphiques synchronisées avec les commutateurs multicaméra et les systèmes d'enregistrement à distance.

Créez votre première vidéo avec Accueil AI gratuitement et testez des fonctionnalités telles que le mouvement photo, le style d'anime et les avatars parlants. Téléchargez une photo, saisissez une invite et choisissez les paramètres d'exportation qui correspondent à votre plateforme cible.

Vous voulez voir à quoi ressemble un avatar DomoAI lors d'une diffusion en direct avec un set virtuel de LTX Studio ? Effectuez le rendu d'un court clip et exécutez-le via votre logiciel de diffusion.

Articles récents

© 2026 DOMOAI PET. LTD.

Accueil AI